阅读:0

听报道

作者:钱天培、魏子敏

训练神经网络是个极为枯燥的工作。与其盯着Learning Curves发呆,或许可以调动一下其他感官,一起做点更有意思的事情。

比如说,眼睛看久了,可以让耳朵也活动活动。

一位酷爱弹吉他的数据科学家就希望,在调参时把其他器官也调动起来共同监督神经网络的训练。

他用一段程序将神经网络训练时的梯度转化成音频,这样,你就可以通过听不同的声音模式知晓训练情况。

把梯度训练变成声音,边听音乐边炼丹

通常,我们需要通过测量许多不同的指标来完成训练,例如准确度、损失、梯度等。多数调参工程师会选择将这些指标整合,并在TensorBoard上绘制可视化图。

而这位名叫Christian S. Perone的数据科学家就厌倦了一直盯着各种参数的传统训练方式,经常玩音乐的他开发了一个小系统,把梯度训练变成声音,并且发布了全部120行代码。

他用一段程序将神经网络训练时的梯度转化成音频,通过听不同的声音模式就知道训练情况。

这是个讨巧的训练监督方式,毕竟,听觉是目前在神经网络训练中很少被用到的感官。而事实上,人类的听觉感官也非常敏锐,可以非常好地区分非常小的特征,例如节奏和音调,即便是很微小或者短暂的变动,人们也很容易有直观的感受。

先一起来看几个非常简单的训练例子。

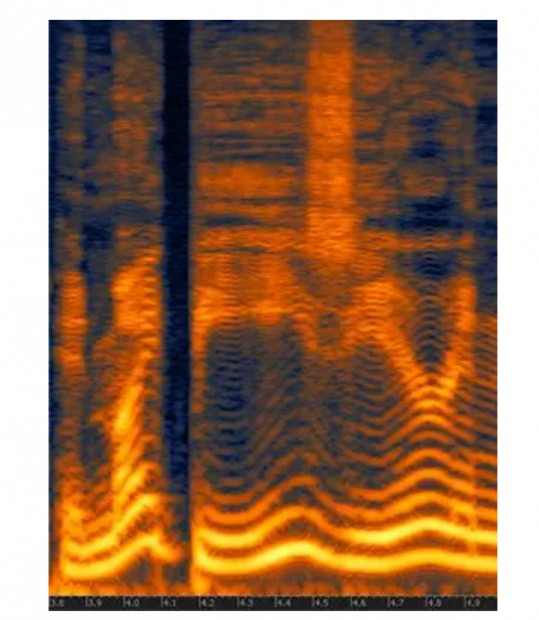

以下的几段声音显示了我们使用每层的梯度范数进行的合成声音,以及使用不同设置(如不同学习率、优化器、动量)对MNIST进行卷积神经网络训练的训练步骤等。

使用LR 0.01训练声音与SGD

此段表示,在第一个epoch的前200个step中使用batch size为10的训练结果。我们选取了0.01的learning rate。音高越高,层的范数(norm)就越高,不同批次之前我们插入了短暂的静音。注意渐变在时间内增加。

使用LR 0.1训练声音与SGD

与上述相同,但我们把learning rate调高到了0.1。

使用LR 1.0训练声音与SGD

与上述相同,但是学习率更高,梯度爆炸并最后发散了,注意高音。嗯,听到最后觉得这个网络大概是死了吧,

使用LR 1.0和BS 256训练声音与SGD

相同的设置,但学习率高达1.0,批量大小为256.注意渐变如何爆炸,然后有NaNs导致最终声音。

这货真的有用吗?

花了这么大力气,我就想知道,靠耳朵调参真的靠谱吗?

没错,如你所料,可能没什么卵用。虽然在上面的例子中,我们可以很明显得听出不同参数的差别,但这些例子都是比较极端的情况。

所以,为什么还要制作这些音频呢?

大概是因为,调参真的是太无聊了吧。

开源代码,自己动手试试吧!

最后,还是放上Christian发布的完整开源代码,你需要安装PyAudio和PyTorch来运行代码。感兴趣的读者,不妨自己试试看。

import pyaudio

import numpy as np

import wave

import torch

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

from torchvision import datasets, transforms

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(1, 20, 5, 1)

self.conv2 = nn.Conv2d(20, 50, 5, 1)

self.fc1 = nn.Linear(4*4*50, 500)

self.fc2 = nn.Linear(500, 10)

self.ordered_layers = [self.conv1,

self.conv2,

self.fc1,

self.fc2]

def forward(self, x):

x = F.relu(self.conv1(x))

x = F.max_pool2d(x, 2, 2)

x = F.relu(self.conv2(x))

x = F.max_pool2d(x, 2, 2)

x = x.view(-1, 4*4*50)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return F.log_softmax(x, dim=1)

def open_stream(fs):

p = pyaudio.PyAudio()

stream = p.open(format=pyaudio.paFloat32,

channels=1,

rate=fs,

output=True)

return p, stream

def generate_tone(fs, freq, duration):

npsin = np.sin(2 * np.pi * np.arange(fs*duration) * freq / fs)

samples = npsin.astype(np.float32)

return 0.1 * samples

def train(model, device, train_loader, optimizer, epoch):

model.train()

fs = 44100

duration = 0.01

f = 200.0

p, stream = open_stream(fs)

frames = []

for batch_idx, (data, target) in enumerate(train_loader):

data, target = data.to(device), target.to(device)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

norms = []

for layer in model.ordered_layers:

norm_grad = layer.weight.grad.norm()

norms.append(norm_grad)

tone = f + ((norm_grad.numpy()) * 100.0)

tone = tone.astype(np.float32)

samples = generate_tone(fs, tone, duration)

frames.append(samples)

silence = np.zeros(samples.shape[0] * 2,

dtype=np.float32)

frames.append(silence)

optimizer.step()

# Just 200 steps per epoach

if batch_idx == 200:

break

wf = wave.open("sgd_lr_1_0_bs256.wav", 'wb')

wf.setnchannels(1)

wf.setsampwidth(p.get_sample_size(pyaudio.paFloat32))

wf.setframerate(fs)

wf.writeframes(b''.join(frames))

wf.close()

stream.stop_stream()

stream.close()

p.terminate()

def run_main():

device = torch.device("cpu")

train_loader = torch.utils.data.DataLoader(

datasets.MNIST('../data', train=True, download=True,

transform=transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))

])),

batch_size=256, shuffle=True)

model = Net().to(device)

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.5)

for epoch in range(1, 2):

train(model, device, train_loader, optimizer, epoch)

if __name__ == "__main__":

run_main()

相关报道:

http://blog.christianperone.com/2019/08/listening-to-the-neural-network-gradient-norms-during-training/

话题:

0

推荐

财新博客版权声明:财新博客所发布文章及图片之版权属博主本人及/或相关权利人所有,未经博主及/或相关权利人单独授权,任何网站、平面媒体不得予以转载。财新网对相关媒体的网站信息内容转载授权并不包括财新博客的文章及图片。博客文章均为作者个人观点,不代表财新网的立场和观点。

京公网安备 11010502034662号

京公网安备 11010502034662号